На конференции Hot Chips 33 Samsung объявила о планах интегрировать вычислительные ускорители во все типы оперативной памяти-от смартфонов до компьютеров, видеокарт и серверов. Это повысит производительность платформ и снизит их энергопотребление. Самое приятное то, что чипы памяти с упреками можно использовать вместо обычной памяти, а поддержка программного обеспечения довольно проста, что уже заинтересовало разработчиков процессоров и графических процессоров.

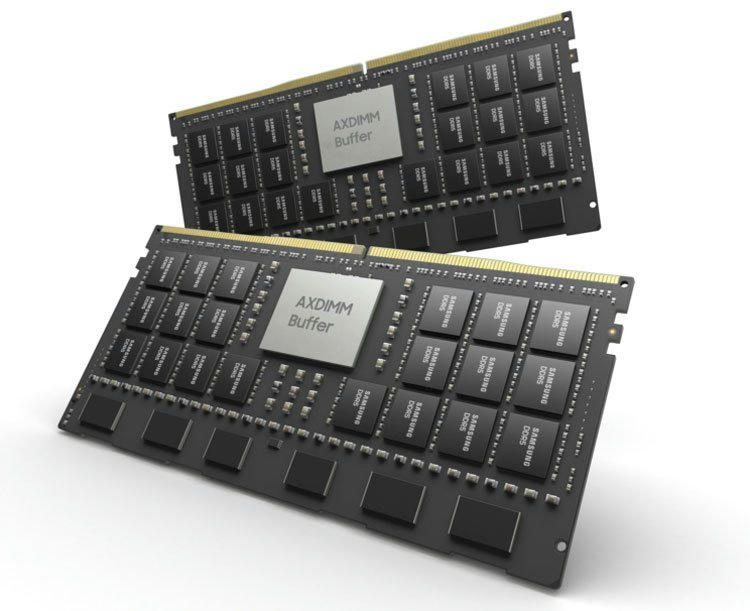

Модуль AXDIMM DDR4. Источник изображения: Samsung

Память PIM (обработка в памяти, вычисления в памяти) в отношении чипов HBM2 Samsung показала в феврале этого года. Каждый чип HBM2 был оснащен программируемым ускорителем искусственного интеллекта с производительностью 1,2 терафлопса (FP16) и мог обрабатывать данные, хранящиеся в памяти напрямую, без их передачи в центральный процессор и обратно. Сегодня компания объявила, что работает над вооружением всех основных типов оперативной памяти ускорителями вычислений, что обещает появление блоков PIM в подсистемах ноутбуков, видеокарт и так далее.

Чип памяти HBM-PIM. Источник изображения: Samsung

Следует сказать, что сегодня ускоритель PIM занимает около половины площади кристалла памяти, что не очень приятно с точки зрения увеличения объемов. В будущем Samsung обещает уменьшить ускоритель, внедряя все более и более плотные чипы оперативной памяти всех типов. В частности, для чипов HBM третьего поколения компания обещает такую же мощность для PIM-HBM3, как и для обычных чипов HBM3. Мы можем предположить, что это возможно благодаря структуре стека этой памяти.

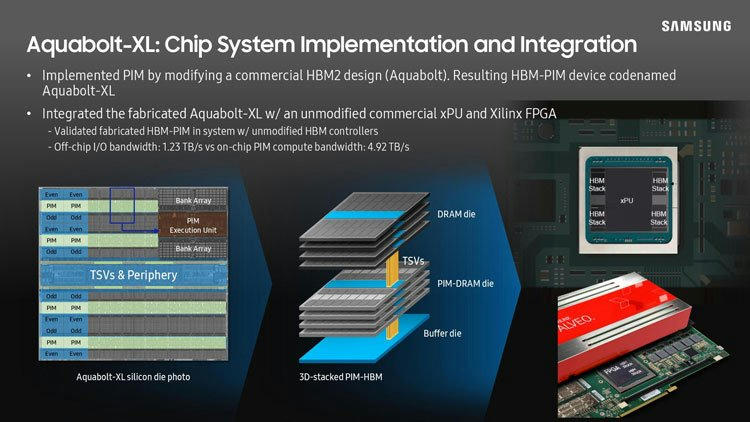

Слои HBM-PIM (теперь бренд Samsung Aquabolt-XL) вставляются непосредственно в стек HBM2 на той же подложке контроллера, что и раньше. Таким образом, проще заменить стеки HBM2 стеками с включением HBM-PIM, заменяя один другим. Такие гибридные стеки были протестированы Xilinx совместно с продуктами Alveo без каких-либо модификаций процессоров и адаптеров (печатной платы или промежуточного устройства). По данным партнеров, производительность выросла в 2,5 раза при одновременном снижении энергопотребления на 62 %. По словам Samsung, ту же операцию можно выполнить с графическим процессором и процессором с аналогичной компоновкой, и разработчики этих решений уже заинтересовались предложением компании.

Слои HBM-PIM могут быть встроены в стандартный стек HBM, и процессору даже не нужно знать об этом. Источник изображения: Samsung

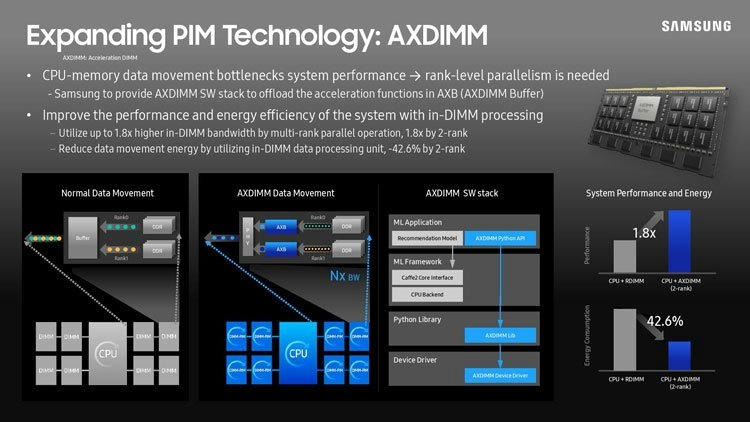

Для самых нетерпеливых Samsung предлагает готовое решение в виде модулей AXDIMM DDR4 (ускорение DIMM). Модули имеют буфер, который помогает обрабатывать данные в памяти, одновременно работая со всеми рангами DRAM на панели. Такой модуль устанавливается на обычном сервере в стандартный слот памяти. Модуль предоставляет все рабочие данные для обработки в памяти с точностью FP16 с использованием стандартных процедур TensorFlow и Python — независимо, и Samsung делает все возможное, чтобы обеспечить поддержку других программных средств.

Компания утверждает, что ее тесты (проведенные на рабочей нагрузке Facebook AI) показали увеличение производительности в 1,8 раза, снижение энергопотребления на 42,6% и сокращение задержки хвоста на 70% с помощью набора 2-го ранга. Мы повторим все это, без улучшений в стандартном сервере, что, безусловно, впечатляет.

Модуль AXDIMM значительно ускоряет обработку данных, ориентированных на ИИ. Источник изображения: Samsung

В мобильных платформах, если говорить об использовании PIM с чипами LPDDR5 и тому подобными, использование вычислений в памяти принесет такое же количество новых функций. Пока компания только моделирует такие процессы, но со временем они обещают появиться в ноутбуках и даже смартфонах. Например, для памяти LPDDR5X-6400 заявлено увеличение производительности в 2,3 раза для рабочих нагрузок распознавания речи, в 1,8 раза для преобразования перевода и в 2,4 раза для генерации текста GPT-2. Эти улучшения производительности сопровождаются снижением потребления в 3,85, 2,17 и 4,35 раза соответственно. Другой вопрос, когда он будет выпущен на рынок? В конце концов, эта технология еще не стала стандартом, одобренным JEDEC.