Технологии, предназначенные для обнаружения человеческих эмоций с помощью алгоритмов машинного обучения, — это огромная индустрия, которая может быть полезна в самых разных ситуациях, от безопасности дорожного движения до маркетинговых исследований. Но критики говорят, что это не только поднимает проблемы конфиденциальности, но и является неточным и расово предвзятым. Исследователи, запустившие новый проект, пытаются бороться с этим мнением.

Источник: Кембриджский университет

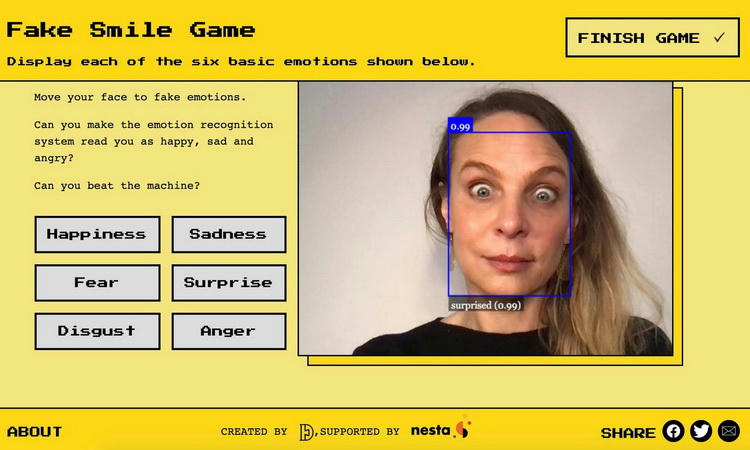

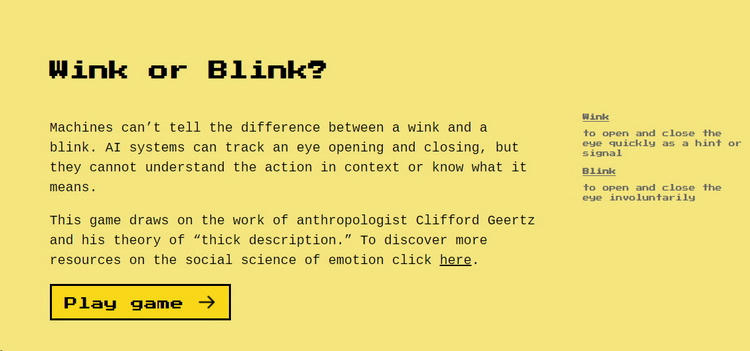

Группа исследователей запустила сайт emojify.Информация, где люди могут сами опробовать системы распознавания эмоций. Одна игра фокусируется на обмане технологии. Пользователям предлагается имитировать эмоции и посмотреть, будут ли они обманывать систему. Другой изучает трудности, с которыми такие системы могут распознавать выражения лица в контексте. Сайт отмечает, что * "никакие персональные данные не собираются, и все изображения хранятся на вашем устройстве"*.

Система считывает движения лица, а затем объединяет полученные данные с предполагаемыми эмоциями — например, улыбка означает, что человек счастлив. Идея состоит в том, чтобы ИИ мог понять, притворяетесь ли вы своими эмоциями. "Игра состоит в том, чтобы показать, что вы не меняли свое внутреннее состояние шесть раз подряд, вы просто изменили то, как выглядит ваше лицо", — сказала доктор Алекса Хагерти, руководитель проекта и исследователь Леверхульмского центра будущего интеллекта при Кембриджском университете и Центра изучения экзистенциального риска.

По словам исследователей, они надеются повысить осведомленность об этой технологии и способствовать обсуждению ее использования.

Технология распознавания лиц, часто используемая для идентификации людей, в последние годы стала объектом пристального внимания. В прошлом году Британская комиссия по вопросам равенства и прав человека заявила, что ей следует прекратить использование технологии сканирования лиц в общественных местах, отметив, что это может усилить дискриминацию со стороны полиции и нанести ущерб свободе выражения мнений.

Но системы распознавания лиц можно использовать в самых разных ситуациях, от найма сотрудника до работы с клиентами, охраны аэропорта и даже обучения, чтобы увидеть, заняты ли студенты или делают домашнее задание. Ранее компания Taigusys, специализирующаяся на системах распознавания эмоций (штаб-квартира находится в Шэньчжэне, Китай), заявила, что использовала их в самых разных условиях-от домов престарелых до тюрем. Индийский город Лакхнау также планирует использовать эту технологию для выявления женщин, которые в последнее время подвергались преследованиям или преследованиям. Это нововведение встретило критику, в том числе со стороны организаций по защите цифровых прав.

В то же время Видуши Марда, старший программный директор правозащитной организации Article 19, считает, что крайне важно нажать на "паузу" на растущем рынке систем распознавания эмоций. "Использование технологий распознавания эмоций вызывает глубокую тревогу, поскольку эти системы не только основаны на дискриминационной и дискредитированной науке, но и принципиально несовместимы с правами человека", — сказала она. — * Важный урок, извлеченный из траектории развития систем распознавания лиц во всем мире, заключается в том, что мы часто и рано ставим под сомнение обоснованность и необходимость технологии, и проекты, которые подчеркивают ограничения и опасности распознавания эмоций, являются важным шагом в этом направлении".